En abril de 2025, el investigador canadiense Cameron D. Norman, experto en evaluación, pensamiento sistémico y diseño estratégico, publicó en su blog Censemaking un artículo titulado “Rhinoceros In The Wild: System Models and Reality”. En este post, Norman utiliza una poderosa metáfora visual —el célebre grabado del rinoceronte de Albrecht Dürer— para abordar una problemática muy actual: el uso excesivo y a veces acrítico de modelos de cambio en el diseño de intervenciones sociales y programas de cooperación.

¿Por qué este artículo merece atención? Este artículo resulta provocador y necesario porque cuestiona el uso extendido de modelos de sistemas que, aunque atractivos y bien intencionados, a menudo carecen de evidencia empírica. Como Dürer, que nunca vio un rinoceronte real pero lo ilustró a partir de relatos, muchas veces diseñamos estrategias de cambio basándonos en ideas no verificadas, suposiciones, o representaciones estilizadas que no reflejan fielmente la complejidad de los contextos en los que trabajamos.

Principales ideas y aportes al campo de la evaluación en cooperación

1. Los modelos no son la realidad

Norman sostiene que muchos modelos de sistemas circulan más como símbolos de cambio que como herramientas basadas en observación y análisis riguroso. Al tratar hipótesis como si fueran certezas, corremos el riesgo de construir soluciones sobre mapas equivocados.

2. La utilidad (y el límite) de los modelos visuales

La evidencia científica respalda el uso de herramientas visuales para el aprendizaje, como demuestra la Dual Coding Theory (Paivio), la Cognitive Load Theory (Sweller), y los trabajos de Mayer, Novak y Cañas. Estos modelos ayudan a comprender conceptos complejos al combinar imágenes y palabras. Sin embargo, Norman subraya que este respaldo no se extiende necesariamente a los modelos mismos que usamos para representar realidades sociales.

3. El riesgo de actuar sin pruebas

Las decisiones estratégicas basadas en modelos inexactos pueden llevar a políticas inefectivas o incluso dañinas, como se ha visto en campañas de salud pública que ignoraron factores sociales y emocionales clave. Norman aboga por una práctica más responsable: antes de adoptar un modelo, debemos preguntarnos si refleja con fidelidad el sistema real.

4. Diseño estratégico basado en evidencia

La propuesta central es clara: integrar diseño estratégico con generación de evidencia. Así como un mapa de carreteras requiere datos sobre clima, pendiente y velocidad para guiar un viaje, los modelos de cambio social requieren datos contextuales y retroalimentación empírica para ser útiles. El diseño sin evidencia es solo un deseo; con evidencia, se convierte en estrategia.

Valor añadido para la evaluación en desarrollo

Para quienes trabajamos en evaluación de políticas y programas en cooperación internacional, este artículo es un recordatorio urgente de que:

- Un modelo atractivo no es garantía de efectividad.

- Necesitamos validar nuestras teorías de cambio antes de aplicarlas.

- La evidencia no es un complemento: es el punto de partida.

- El pensamiento visual debe estar acompañado de pensamiento crítico y empírico.

Este enfoque promueve una práctica de evaluación más rigurosa, adaptativa y consciente de su responsabilidad ética.

Referencias

Referencias

- Mayer, R. E. (2001). Multimedia learning. Cambridge University Press.

- Novak, J. D., & Cañas, A. J. (2008). The theory underlying concept maps and how to construct them. Florida Institute for Human and Machine Cognition.

- Paivio, A. (1971). Imagery and verbal processes. Holt, Rinehart, and Winston.

- Sweller, J. (1988). Cognitive load during problem solving: Effects on learning. Cognitive Science, 12(2), 257–285.

- Yarkoni, T., Speer, N. K., & Zacks, J. M. (2008). Neural substrates of narrative comprehension and memory. NeuroImage, 41(4), 1408–1425.

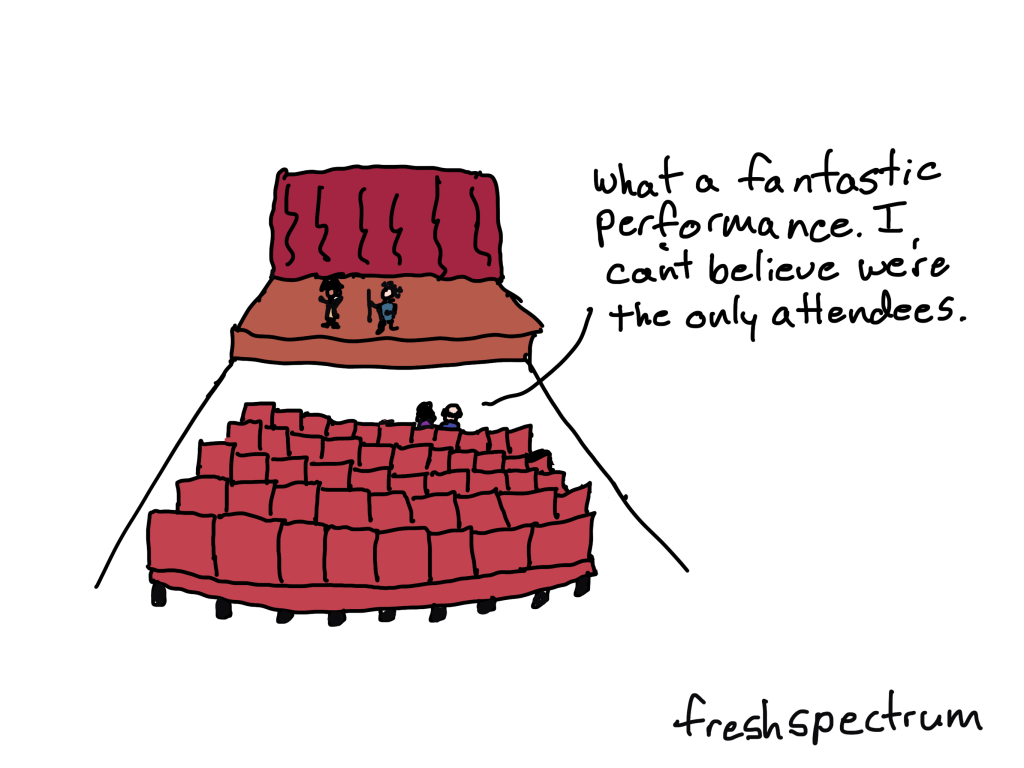

Evaluar sin que haya nada real que evaluar

Evaluar sin que haya nada real que evaluar la Evaluability Assessment (evaluación de evaluabilidad)

la Evaluability Assessment (evaluación de evaluabilidad) Evaluabilidad vs. Preparación: ¿cuál es cuál?

Evaluabilidad vs. Preparación: ¿cuál es cuál? Diferencias clave

Diferencias clave ¿Cuál necesitas ahora?

¿Cuál necesitas ahora? Una buena Evaluability Assessment puede evitar evaluaciones huecas o prematuras.

Una buena Evaluability Assessment puede evitar evaluaciones huecas o prematuras.