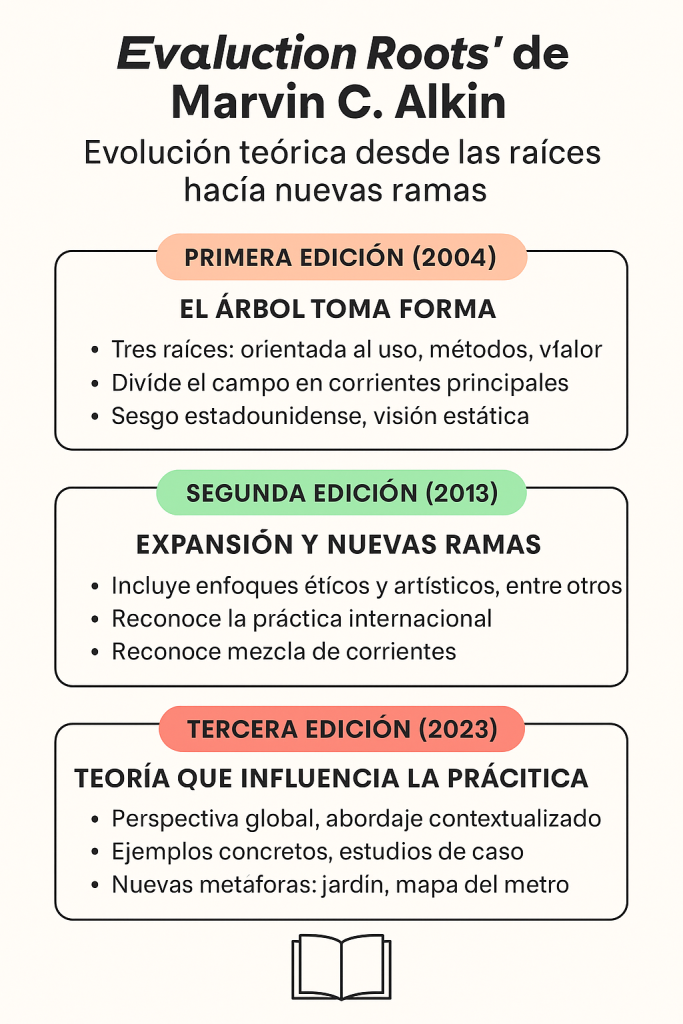

En el vasto y complejo universo de la evaluación de programas, Evaluation Roots, editado por Marvin C. Alkin, se erige como una obra fundamental. Desde su primera edición en 2004, pasando por su expansión en 2013, hasta su versión más inclusiva y aplicada en 2023, este libro no solo compila teorías evaluativas, sino que traza una genealogía viva del pensamiento evaluativo contemporáneo. Más que un texto, Evaluation Roots es un mapa conceptual, un árbol teórico, un jardín de ideas en evolución constante.

Este post reúne, fusiona y profundiza todas las ideas clave de las tres versiones analizadas sobre el libro, integrando los aportes dispersos de cada reseña en un ensayo único, cohesivo y exhaustivo.

1. La metáfora fundacional: El árbol de la evaluación

1. La metáfora fundacional: El árbol de la evaluación

Desde su concepción, Evaluation Roots propone una visión gráfica y conceptual del campo: un árbol cuyas raíces representan las grandes corrientes teóricas, de las cuales surgen diversas ramas, teorías híbridas y aplicaciones prácticas. Esta metáfora ha sido celebrada por su claridad y utilidad pedagógica.

Las tres raíces principales:

- Use Branch (orientada al uso): encabezada por Michael Q. Patton, enfatiza la importancia del uso real de los resultados de evaluación por los tomadores de decisiones.

- Methods Branch (orientada a métodos): representada por figuras como Donald Campbell, pone el acento en el rigor científico, la medición precisa y el diseño metodológico.

- Valuing Branch (orientada a valores): liderada por Michael Scriven, se centra en el juicio evaluativo basado en criterios explícitos de valor, a menudo independiente del diseño del programa.

Cada raíz está asociada con autores clave, trayectorias intelectuales y debates metodológicos. Esta estructura permite entender que la evaluación no es una práctica neutral ni técnica, sino una disciplina anclada en fundamentos epistemológicos, éticos y políticos.

2. Contenido estructural de las ediciones

2. Contenido estructural de las ediciones

Primera edición (2004) – La genealogía toma forma

Primera edición (2004) – La genealogía toma forma

Alkin organiza por primera vez la disciplina en torno a las tres raíces mencionadas. La obra ofrece una visión clara pero centrada en el contexto estadounidense, con poca representación internacional. Aun así, introduce un marco teórico sólido, visual y accesible, que ha servido de referencia fundacional.

Segunda edición (2013) – Nuevas ramas y conexiones

Segunda edición (2013) – Nuevas ramas y conexiones

Esta edición amplía el número de autores y teorías abordadas. Incorpora a Ernest House (evaluación ética) y Elliot Eisner (evaluación artística), y reconoce intersecciones entre ramas. La teoría evaluativa comienza a verse como un sistema ecológico, donde las ideas no solo coexisten, sino que se influyen mutuamente. La noción de “ecología de teorías” de Fitzpatrick et al. (2011) toma fuerza aquí.

Tercera edición (2023) – Globalización, práctica y metáforas alternativas

Tercera edición (2023) – Globalización, práctica y metáforas alternativas

Con el subtítulo Theory Influencing Practice, la tercera edición marca un cambio profundo. Tres elementos la distinguen:

- Internacionalización: Se integran perspectivas no occidentales, como la Evaluación Culturalmente Responsiva (CRE) y la Evaluación Indígena, reflejando una apuesta por la diversidad epistemológica (Carden & Alkin, 2012).

- Aplicación concreta: Casos reales ilustran cómo las teorías guían decisiones metodológicas y prácticas en contextos reales.

- Visualizaciones alternativas: Surgen metáforas como el río (Aston, 2024), el mapa del metro o el jardín (Montrosse-Moorhead et al., 2024), que cuestionan la linealidad del árbol y promueven una visión rizomática y fluida del campo.

3. Temas y mensajes principales

3. Temas y mensajes principales

- La evaluación no es neutral ni única. Cada enfoque responde a propósitos, públicos y contextos históricos distintos.

- Los teóricos no trabajan en aislamiento. Hay diálogo, tensión y evolución continua entre marcos.

- El contexto importa. La práctica evaluativa debe adaptarse a las condiciones socioculturales, económicas y políticas.

4. Aplicaciones prácticas

4. Aplicaciones prácticas

El libro funciona como una brújula para profesionales. Comprender las raíces teóricas ayuda a:

- Elegir métodos apropiados según el contexto.

- Diseñar evaluaciones culturalmente sensibles.

- Justificar elecciones teóricas frente a múltiples stakeholders.

5. Perspectiva internacional

5. Perspectiva internacional

La colaboración con Fred Carden en Evaluation Roots: An International Perspective subraya cómo la evaluación se ha adaptado a contextos del Sur Global, donde las realidades institucionales, culturales y políticas son distintas. Este giro internacionaliza el campo, reconociendo la legitimidad de marcos no tradicionales.

6. Innovación visual: más allá del árbol

6. Innovación visual: más allá del árbol

Las nuevas metáforas proponen:

Árbol: lineal, estructurado y didáctico.

Árbol: lineal, estructurado y didáctico. Río: fluido, evolutivo y sin principio fijo.

Río: fluido, evolutivo y sin principio fijo. Jardín: simultaneidad de enfoques que florecen en distintos contextos.

Jardín: simultaneidad de enfoques que florecen en distintos contextos. Mapa del metro: rutas múltiples que se conectan en nodos teóricos compartidos.

Mapa del metro: rutas múltiples que se conectan en nodos teóricos compartidos.

Estas visualizaciones reflejan un campo interconectado, plural y en movimiento.

7. Comparaciones clave

7. Comparaciones clave

| Obra | Enfoque | Diferenciador |

| Evaluation: A Systematic Approach (Rossi et al., 2004) | Técnico y normativo | Diseño paso a paso |

| Utilization-Focused Evaluation (Patton, 2008) | Pragmático y centrado en el uso | Evaluaciones en entornos reales |

| Evaluation Roots (Alkin, varias ed.) | Histórico y teórico | Fundamentos, genealogía, visualización |

Evaluation Roots no enseña a evaluar, sino a pensar críticamente la evaluación.

8. Críticas y límites

8. Críticas y límites

- Foco inicial excesivamente estadounidense.

- Ausencia parcial de marcos centrados en justicia social y equidad (Chelimsky, 1997).

- Necesidad constante de actualización ante nuevos desafíos evaluativos (inteligencia artificial, descolonización del conocimiento, etc.).

9. Recomendaciones bibliográficas complementarias

9. Recomendaciones bibliográficas complementarias

- Stufflebeam – Evaluation Theory, Models, and Applications.

- Scriven – The Discipline of Evaluation.

- Patton – Developmental Evaluation.

- Chelimsky & Shadish – Evaluation for the 21st Century.

- Montrosse-Moorhead et al. – The Garden of Evaluation Approaches (2024).

10. Impacto cultural y formativo

10. Impacto cultural y formativo

Desde su publicación, Evaluation Roots ha sido referencia en programas de posgrado en educación, políticas públicas y salud. Ha influido en cómo las nuevas generaciones de evaluadores entienden su rol no como técnicos, sino como actores críticos en escenarios de poder, conflicto, aprendizaje e innovación.

Reflexión final: De raíces a rizomas

Reflexión final: De raíces a rizomas

Cada edición de Evaluation Roots ha sido más ambiciosa, inclusiva y aplicada. Lo que comenzó como un árbol teórico se ha expandido hacia estructuras rizomáticas, donde el conocimiento ya no crece solo hacia arriba, sino en múltiples direcciones, respondiendo a complejidades sociales, culturales y políticas.

La evaluación, en esta concepción, no es simplemente técnica: es un acto ético, político y contextualizado. Como práctica, exige conciencia crítica; como disciplina, demanda apertura epistémica; y como herramienta, puede contribuir activamente a la transformación social.

Fuentes y referencias clave

Fuentes y referencias clave

Referencias destacadas

- Alkin, M. C. (Ed.). (2004). Evaluation Roots: Tracing Theorists’ Views and Influences (1st ed.). SAGE Publications.

- Alkin, M. C. (Ed.). (2013). Evaluation Roots: A Wider Perspective of Theorists’ Views and Influences (2nd ed.). SAGE Publications.

- Alkin, M. C., Christie, C. A., & Stephen, N. A. (2023). Evaluation Roots: Theory Influencing Practice (3rd ed.). SAGE Publications.

- Christie, C. A., & Alkin, M. C. (2008). Evaluation Theory Tree Re-examined. Studies in Educational Evaluation, 34(3), 131–135.

- Carden, F., & Alkin, M. C. (2012). Evaluation Roots: An International Perspective. Journal of MultiDisciplinary Evaluation, 8(17).

- Aston, T. (2024). Repositioning Evaluation Theory Trees. Medium.

- Montrosse-Moorhead, B., Schroeter, D., & Becho, L. (2024). The Garden of Evaluation Approaches. Journal of MultiDisciplinary Evaluation, 20(45).

- Patton, M. Q. (2008). Utilization-Focused Evaluation (4th ed.). SAGE Publications.

- Scriven, M. (1991). Evaluation Thesaurus (4th ed.). SAGE Publications.