This article is rated as:

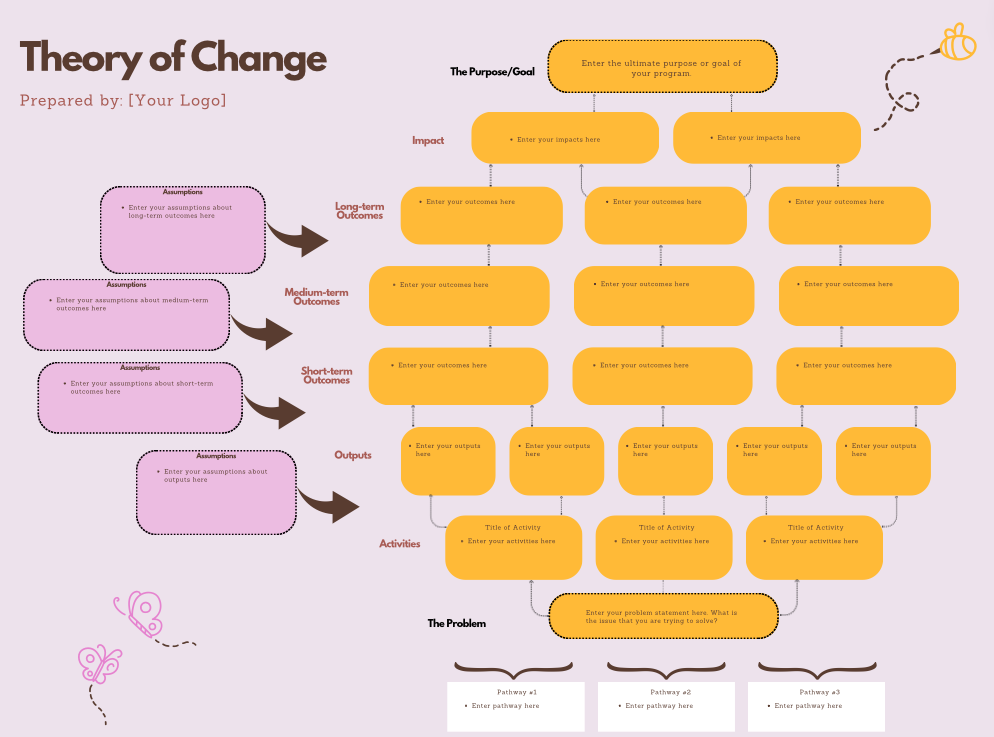

Eval Academy just released a new template, “Canva design templates for creating your own Theory of Change”

Who’s it for?

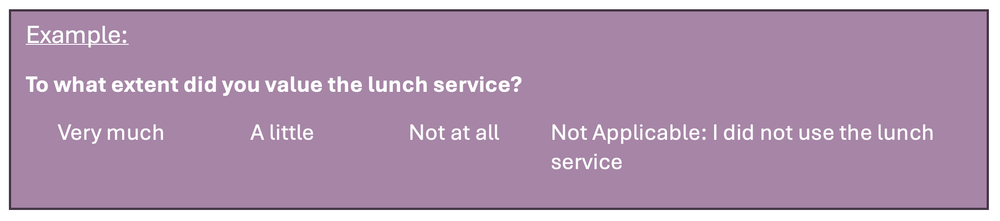

Whether you’re new to evaluation or if evaluation is your main role, this Canva design template is for anyone who wants to design a Theory of Change to be more visually appealing. To use this template, you will need to set up or log in to your own account in Canva.

What’s the purpose?

This Canva design template can be used to present your own Theory of Change for any type of intervention in a more distinct format. It’s great for sharing your Theory of Change with a wider audience, such as when you want to share your model on your website.

What’s included?

One customizable Canva template that provides you with the space you need to input your Theory of Change components.

Learn more: related articles and links

You can learn more about Theories of Change on Eval Academy through the following links:

You can also find many other templates in our list of resources to support you in planning and implementing an evaluation. Some of our most popular templates include: